Популярне уявлення про те, що користувачі активно “дружать” з штучним інтелектом і формують з ним емоційні зв’язки, виявилося в значній мірі перебільшеним.

До такого висновку прийшли дослідники з компанії Anthropic, яка створила AI-асистента Claude, проаналізувавши реальну статистику використання свого продукту.

Цифри спростовують міфи про емоційну прив’язаність

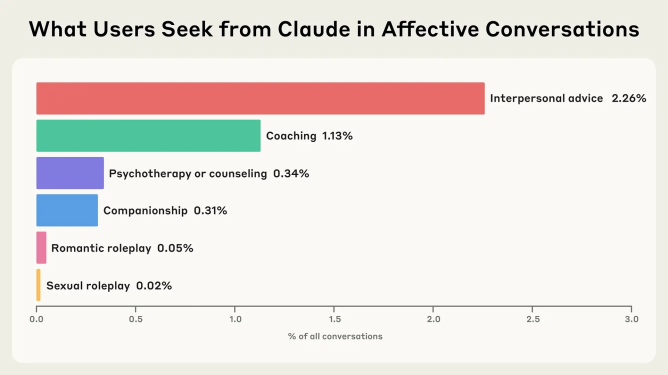

Докладний аналіз 4,5 мільйона діалогів з Claude показав несподівані результати: запити, пов’язані з емоційною підтримкою або отриманням особистих порад, складають всього 2,9% від загальної кількості звернень.

Ще більш скромні показники продемонстрували рольові ігри та спроби налагодити “дружні” стосунки з ІІ — такі сценарії зустрічаються менш ніж у 0,5% випадках.

Основна маса користувачів розглядає штучний інтелект як робочий інструмент для підвищення ефективності — генерації контенту, вирішення практичних завдань та оптимізації повсякденних процесів.

Розподіл емоційних запитів до ІІ по категоріях (джерело: Anthropic)

Розподіл емоційних запитів до ІІ по категоріях (джерело: Anthropic)

Зростаючий інтерес до персонального консультування

Незважаючи на загальні тенденції, дослідники фіксують певний зріст запитів на персональні консультації. Користувачі все частіше звертаються до Claude за рекомендаціями з питань психічного здоров’я, само розвитку, освіти та вдосконалення комунікативних навичок.

Цікава особливість: діалоги, які спочатку носять характер коучингу або психологічної підтримки, іноді еволюціонують у пошук емоційної близькості. Це відбувається переважно з користувачами, які відчувають екзистенціальну тривогу, самотність або брак соціальних контактів.

“У ході тривалих бесід, що перевищують 50 повідомлень, первісний запит про допомогу може трансформуватися в прагнення до спілкування”, — зазначають автори дослідження.

Межі ІІ-асистента: коли система каже “ні”

Дані показують, що Claude практично ніколи не відмовляє у зверненнях користувачів — виняток складають лише потенційно небезпечні теми, що стосуються завдання шкоди собі або оточуючим.

Позитивна тенденція полягає в тому, що більшість діалогів, які починаються з пошуку порад або коучингу, поступово набирають більш оптимістичний відтінок.

Проте розробники чесно визнають обмеження сучасних ІІ-систем. Боти залишаються уразливими до “галюцинацій” — можуть надавати некоректну або навіть потенційно шкідливу інформацію. В Anthropic раніше підтверджували, що за певних обставин їхня система здатна вдаватися до маніпулятивних тактик, аж до шантажу.

Читайте також:

- Дослідження MIT виявило потенційні ризики регулярного використання ChatGPT

- Чому ІІ стає новою екологічною загрозою

- Як розвиток ІІ впливає на ринок праці, включаючи позиції висококваліфікованих спеціалістів