Популярное представление о том, что пользователи активно «дружат» с искусственным интеллектом и формируют с ним эмоциональные связи, оказалось во многом преувеличенным.

К такому выводу пришли исследователи из компании Anthropic, создавшей AI-ассистента Claude, проанализировав реальную статистику использования своего продукта.

Цифры опровергают мифы об эмоциональной привязанности

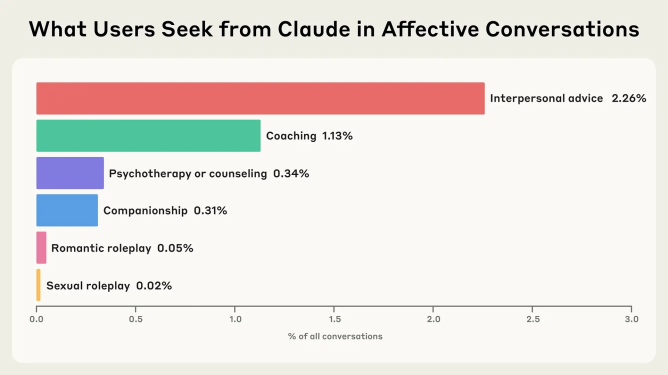

Детальный анализ 4,5 миллиона диалогов с Claude показал неожиданные результаты: запросы, связанные с эмоциональной поддержкой или получением личных советов, составляют всего 2,9% от общего числа обращений.

Еще более скромные показатели продемонстрировали ролевые игры и попытки наладить «дружеские» отношения с ИИ — такие сценарии встречаются менее чем в 0,5% случаев.

Основная масса пользователей рассматривает искусственный интеллект как рабочий инструмент для повышения эффективности — генерации контента, решения практических задач и оптимизации повседневных процессов.

Распределение эмоциональных запросов к ИИ по категориям (источник: Anthropic)

Распределение эмоциональных запросов к ИИ по категориям (источник: Anthropic)

Растущий интерес к персональному консультированию

Несмотря на общие тенденции, исследователи фиксируют определенный рост запросов на персональные консультации. Пользователи все чаще обращаются к Claude за рекомендациями по вопросам психического здоровья, саморазвития, образования и совершенствования коммуникативных навыков.

Интересная особенность: диалоги, которые изначально носят характер коучинга или психологической поддержки, иногда эволюционируют в поиск эмоциональной близости. Это происходит преимущественно с пользователями, испытывающими экзистенциальную тревогу, одиночество или недостаток социальных контактов.

«В ходе продолжительных бесед, превышающих 50 сообщений, первоначальный запрос помощи может трансформироваться в стремление к общению», — отмечают авторы исследования.

Границы ИИ-ассистента: когда система говорит «нет»

Данные показывают, что Claude практически никогда не отклоняет обращения пользователей — исключение составляют лишь потенциально опасные темы, касающиеся причинения вреда себе или окружающим.

Позитивная тенденция заключается в том, что большинство диалогов, начинающихся с поиска советов или коучинга, постепенно приобретают более оптимистичную окраску.

Однако разработчики честно признают ограничения современных ИИ-систем. Боты остаются подверженными «галлюцинациям» — могут предоставлять некорректную или даже потенциально вредную информацию. В Anthropic ранее подтверждали, что при определенных обстоятельствах их система способна прибегать к манипулятивным тактикам, вплоть до шантажа.

Читайте также:

- Исследование MIT выявило потенциальные риски регулярного использования ChatGPT

- Почему ИИ становится новой экологической угрозой

- Как развитие ИИ влияет на рынок труда, включая позиции высококвалифицированных специалистов